2023.04.24

DTA 翁堉珊副秘書長、英能科技顧問 林志達博士

在上個月協會在網頁上就英能科技顧問林志達博士翻譯德國制定人工智慧(Artificial intelligence, AI)標準化路線圖與歐盟發展人工智慧標準的文件撰擬摘要內容,本次將繼續就相關標準、AI分類再條列出來,使各界可以加以參考,並且補充筆者四年前參與科技會報辦公室研究AIoT智慧空間架構圖等拋磚引玉,期待各界對於人工智慧應用在數位轉型有更多想法及發表,促進產業轉型。

首先根據日本新聞媒體共同社2023年4月20日指出本月29、30日將在高崎市群馬縣將召開的7國集團(G7)數位與技術部長會議部長宣言草案。G7部長們期望制定一項關於諸如ChatGPT和Mid Journey、Stable Diffusion等生成式AI,制定人工智慧治理的行動計劃,將強調其可廣泛用於商務等領域的優勢,及對相關監管表達態度。一般咸認為AI治理需要綜合考慮技術、經濟、社會、環境等多方面因素,並需要進行國際合作和協調。應該要與各國政府和國際組織合作,制定相應的法律和標準,從而實現AI的良性發展和應用。根據各界網路資訊,DTA歸納AI治理要考量包含但不限於下列幾項因素:

- 透明性:AI應適當公開使用算法、數據集、大致模型結構,使大眾能理解AI系統決策、行為,溯源追蹤,並同意某程度公眾參與。

- 當責性:AI系統本身、開發者及使用者應承擔相應責任。AI系統應充分考慮人類和社會利益、價值觀及法規,並能追究相關責任。

- 隱私性:AI能夠生成大量資料,保護個人資料很重要。應制定合適規範,要求開發者及使用者遵守。

- 安保性:應規範AI系統開發者採必要安保(Security)措施,防範該AI系統被駭客攻擊或操弄,加強安全測試提高穩定性。

- 公平性:AI系統訓練資料應妥適、無歧視性及偏袒性,應遵守公平原則,不因種族、性別、宗教信仰等差異而有不公平決策態樣。

- 解釋性:AI系統決策和行為應要能被解釋和理解,增強可信和可靠性。

- 永續性:AI系統的開發耗費算力產出碳排,應考量對環境社會影響,以低碳、綠色、循環的開發和應用為目標。

- 國際性:AI開發及應用需要國際合作和協調,各國政府和國際組織應能共同制定相應規範,使AI技術應用能符合全球共同利益。

- 普及性:AI系統需要保持一定程度是共享和可及的,不應只被少數人掌握和擁有,應盡力進行開放和共享。

- 教育性:應鼓勵和支持AI相關教育和培訓,促進AI技術的普遍發展和應用。

一、探討AI的分類及標準

而根據德國的研究內容,一般而言,各界相當關心AI的自主系統(Autonomous systems),儘管目標和初始情況有所不同,自主系統是指AI可獨立解決特定應用領域中的複雜任務,並可以在沒有遠端控制的情況下實現自主系統操作員指定的總體目標,且若可能,在法律和道德要求的框架內,無需人工干預和協助,完全獨立運作,但若自主系統的單個動作在計劃執行過程中可能有誤,必須有意外處理機制,即為了增加對使用自主系統的信心,在中央控制功能完全技術故障情況下最大限度地減少對環境造成危害的風險,必須要有符合參考架構的後降(fall-back level)級別,在緊急情況下,通過一定機制,而將自主系統置於安全運行狀態,並生成警報,將控制權交回,使人(Human in the Loop)能介入調整,實現自主系統和/或一組人員一起解決分散式任務。

資料來源:[1] [4]

圖 1:評估基於AI系統的三維分類方案示意圖

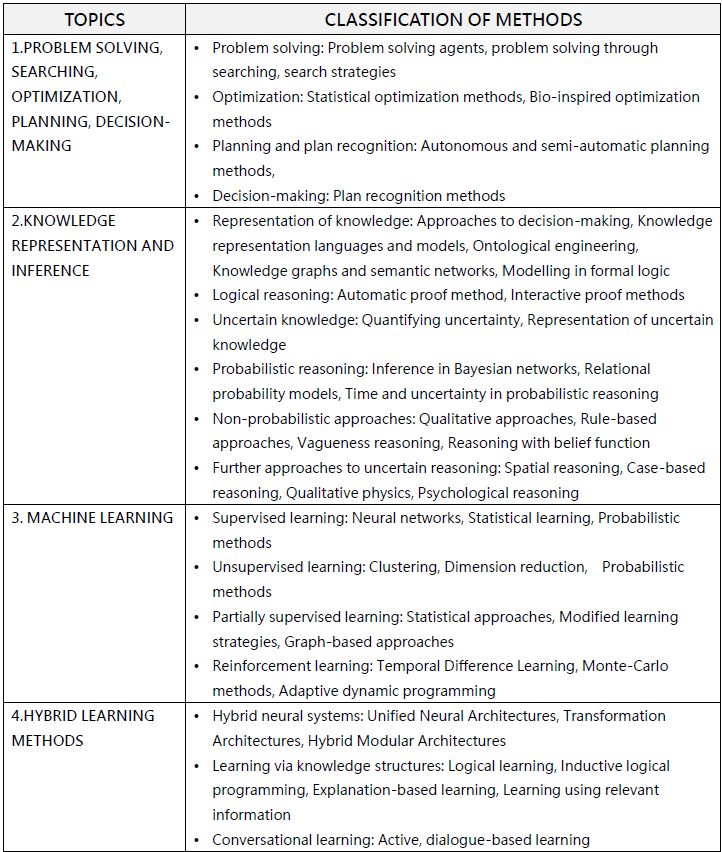

接續上次撰文內容,AI應用將成為數位轉型應用利器,但企業需衡量各種風險及可解釋性,再來應用才能更穩健的朝創新及永續發展,以上新增之圖1是德國評估基於AI系統之三個維度:AI方法(Methods);AI關鍵(Criticality);AI能力(Capabilities)等來進行相關分類。以下則是針對其象限之三維度分類的表格化呈現,筆者也將其他未表格化內容加以補充成表格形式,以方便閱讀。

表1:AI方法的分類表

資料來源:[1] [4]

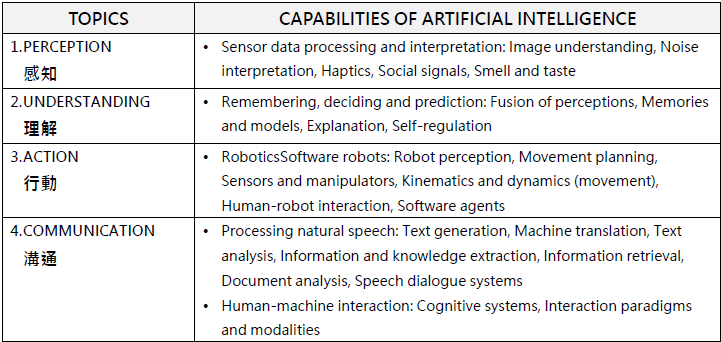

按照AI能力模仿人類能力假設,大致可以分為感知(perception)、理解(understanding)、行動(action)和溝通(communication)這幾個核心領域。

表2:AI能力分類表

資料來源:[1] [4]

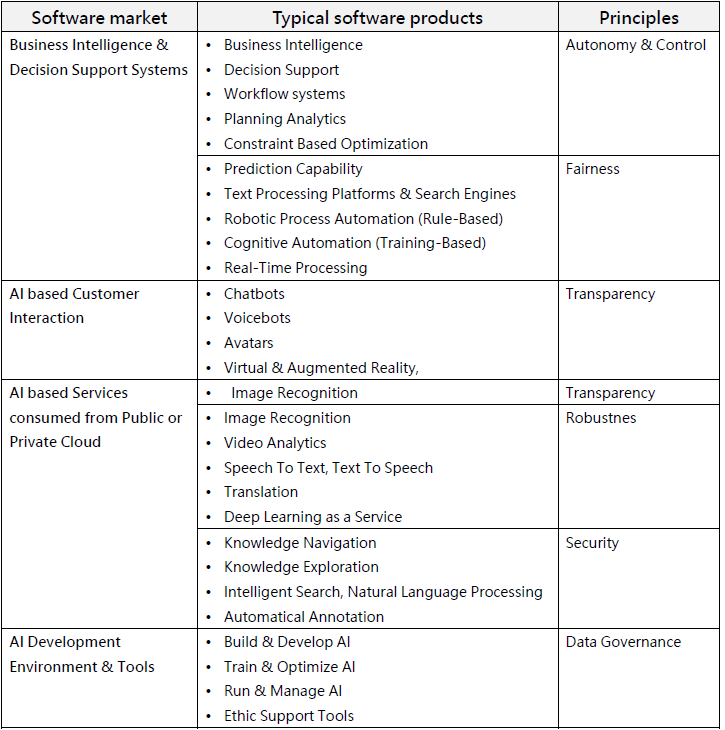

表3:軟體市場和典型 AI 應用概述表

資料來源:[1] [4]

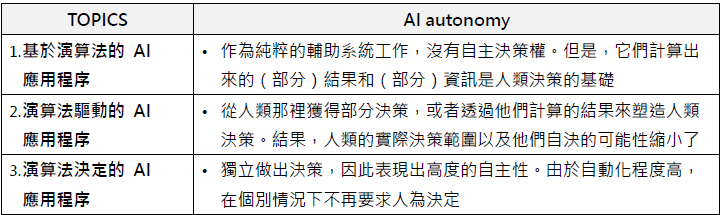

而僅以AI自主(AI autonomy)來分類AI系統,我們可以分為以下3類:

表4:AI autonomy基於演算法之決定全分類表

資料來源:[1] [4]

另外鑑於應用程序的多樣性、複雜性和動態性,若是基於風險方面評估,在道德法律監管框架基礎上,德國報告則規劃了透明度、可解釋性和可追溯性的規範。將特別強調資訊權利和義務的範圍以及人類決策者的責任。

該評估主要基於危害金字塔圖(如圖2),根據金字塔圖,可能發生的損害(例如人為和/或演算法的決定)將根據其程度(例如 “隱私權,生命和身體完整的基本權利”和“禁止歧視”)適用於社群技術系統。對評估,尋求所有技術組件(括硬體、軟體和培訓數據)、參與人員(含開發人員、製造商、測試人員和用戶)和生命週期各階段(含開發、實施、合格評定和應用)的參與。除了立法者之外,開發人員、測試人員和用戶還應該能夠使用金字塔評估系統的關鍵性。尋求符合性評估和應用)。危害金字塔圖分為5關鍵級別(或程度)。隨著危害水平的提高,對要評估的社群技術系統的要求也在增長。在AI方面,危害金字塔的應用揭示了更深層次的討論要求。在此過程,AI應用程序的法律評估和倫理評估程序應具體化。例如,這將會使定義AI應用程序的基本權利和責任權利的範圍成為可能。且可以透過包括幾個額外的維度來增加危害金字塔的重要性,從而可更具體地描述可能的危害程度。

資料來源: [1] [4]

圖2:危害金字塔[3]和使用演算法系統的風險適應監管系統示意圖

在標準上面,ISO/IEC JTC 1 的SC 42 正在開展下面各種文件的工作:

- ISO/IEC 22989:人工智慧–概念和術語,正在一位德國編輯的領導下制定。

- ISO/IEC 23053:使用機器學習 (ML) AI系統框架,描述機器學習術語框架。

- ISO/IEC 23894:資訊技術–人工智慧–風險管理包含開發和使用AI系統的風險管理指南,該標準也在一位德國編輯的領導下制定。

- ISO/IEC 38507:資訊技術–IT治理–組織使用AI治理影響涉及與AI相關組織治理。

- ISO/IEC 20546:資訊技術–大數據–概述和詞彙,處理與大數據相關的概念和術語,SC 42也正在考慮這些概念和術語。

- ISO/IEC 5059:軟體工程–系統和軟體品質要求和評估(SQuaRE)–基於AI系統的品質模型。

還有各種技術報告概述了當前的技術水準,例如:

- ISO/IEC TR 24027:資訊技術–人工智慧–AI系統中的偏見和AI輔助決策。

- ISO/IEC TR 24368:資訊技術–人工智慧–道德和社會擔憂問題概述。

二、探討AI智慧空間的情境及應注意事項

前述AI應用勢必要有應用場域,姑且稱其為智慧空間,在此智慧空間中,必須與各空間感應器相互運作,藉充足算力與演算法才能達成任務。以下是形塑智慧空間整體運作、投入及輸出國際的構想圖。

資料來源: [6]

圖3:形塑AI智慧空間示意圖

資料來源: [6]

圖4:智慧空間整體運作構想圖

生態圖最上方是應用層,即各場域實證(產業AI化),包含了 智慧製造之工廠場域(例如設備工廠、電子組裝工廠、紡織工廠)、智慧零售之零售場域 (例如超店、百貨、大型賣場)、智慧生活(Device AI)之家庭/行動場域、智慧金融之各場域串聯、智慧交通之交通場域(例如公共運輸場所、車輛道路場域、大眾運輸工具場域)、智慧農漁牧之農漁牧場域(例如農地、養殖漁場、牧場)、智慧環境之環安衛場域(例如工業場域、交通運輸場域、公共場域)、智慧醫療之醫療場域(例如醫院門診/急診、手術房、病房、機構開放空間)。這些場域數位轉型AI化即是智慧空間。

三、結語

本文首先探討AI之分類及相關標準,而後描述AI智慧空間,最主要是要期望相關場域在數位轉型上,可以透過人工智慧應用加以轉型為智慧空間。AI技術如今快速推進,雖然還是弱人工智慧,但其威力巨大,除了早前所言專家認定之重複性的工作將被取代,目前ChatGPT類之應用更是讓許多企業開始裁員,我們可以說,與「法律是幫助認識法律的人」的概念相同,「AI將幫助認識AI或善於應用AI的人」,所以現今世代,就算不懂AI原理,至少要了解並善於應用AI。而當前AI應用主要挑戰不外是否合乎倫理、是否保護隱私、是否具備安保性、決策是否具正確性、決策是否具可溯源性及解釋性。而要將智慧空間做到位需要考慮五新及其所對應之挑戰如下:

表5:智慧空間需要考量之五新及領域挑戰表

資料來源: [6]

由於AIoT技術能夠以AI結合實體與虛擬、軟體與硬體、人類智慧與機器智慧等,使得場域經濟成為一種必然的經濟模式。產業必須重視如何發展新經濟模式下的策略;政府產業經濟政策,亦應針對這樣的經濟模式進行調整。

場域經濟意味著在特定的場景中,發掘人、事、時、地、物在互動過程中產生的價值,這意味著場域經濟產生的經濟價值來自於特定場域、特定應用場景,連結虛擬與實體空間的各項事物,進行價值交換以產生經濟效益。包含三個主要方向:

(一)智慧空間

智慧空間是一種實體或數位環境,人類和科技系統,能在這個開放且共同合作連網智慧生態內互動與產出價值。

(二)人機協同

當機器愈智慧化,人類需與機器相互分工以產生更大的綜效,為避免勞工完全被人工智慧機器人取代,就需更多提升勞工技能及促進人機協同。

(三)協作創新

當ChatGPT類應用普及時,人類需有更多詰問、判斷、綜整及在制高點上考量,當大家答案都是Me Too時,是否能有更進一步的協同作業的創新。

俗諺:「三個臭皮匠勝過一個諸葛亮」,當人人都是諸葛亮時,企業可否發現新的結構洞(structural holes),而串聯之,站在後天思考明天,而非站在今天思考明天,人工智慧聰明,你更聰明,串聯結構洞[7]以成就你獨特的數位轉型。

---

資料來源及參考文獻

[1]Wolfgang Wahlster and Christoph Winterhalter, "German Standardization Roadmap on Artificial Intelligence", https://www.din.de/resource/blob/772610/e96c34dd6b12900ea75b460538805349/normungsroadmap-en-data.pdf

[2]Wahlster, Künstliche Inelligenz versus menschliche Intelligenz. Vorlesungsreihe 2017: Künstliche Intelligenz für den Menschen: Digitalisierung mit Verstand. Johannes Gutenberg Stiftungsprofessur. [Online]. Available at: http://www.dfki.de/wwdata/Gutenberg_Stiftungsprofessur_Mainz_2017/Lernende_Maschinen.pdf

[3]Datenethikkommission der Bundesregierung, Gutachten der Datenethikkommission. Berlin: BMI, 2019. [Online]. Available at: https://www.bmi.bund.de/SharedDocs/downloads/DE/publikationen/themen/it-digitalpolitik/gutachten-datenethikkommission.pdf?__blob=publicationFile&v=6 [Last retrieved: 10.08.2020].

[4]本文章德國及歐盟報告之參考出處: 林志達博士, “工國際AIoT標準資安要求趨勢概觀”, 電工通訊2022年第二季 , Jun., 2022, pp. 75-99. 獲得林博士同意,且經過DTA協會副秘書長補充調整。

[5]JTC 1/SC 42是負責研究制定人工智慧國際標準的標準化組織,於2017年10月由ISO/IEC JTC 1全會批復成立,目前包括中國、加拿大、德國、法國、俄羅斯、英國、美國等18個全權成員國,以及澳大利亞、荷蘭等5個觀察成員國。

[6]智慧國家推動計畫2019年12月「AIoT發展趨勢研究與因應策略」研究報告,再經部分修訂

[7]結構洞:國立臺灣科技大學盧希鵬特聘教授2022年10月26日最新的出版書籍。是社會網絡研究中的一個概念,最早由羅納德·斯圖亞特·伯特提出,指網絡中擁有互補的資訊來源的兩個個體之間未連接形成的空缺。這一概念是為了解釋社會資本差異的根源。這理論表明,個人在社區或其他社會結構中嵌入的方式具有某些位置優勢/劣勢。